Midjourney, der Pionier in der ästhetischen Bilderzeugung, ist mit der Veröffentlichung von Video V1 offiziell in die Welt der KI-gestützten Videos eingetreten. Dieses leistungsstarke Modell ermöglicht es Benutzern, Standbilder in fesselnde, bewegungsreiche Kurzclips zu animieren. Mit dieser Einführung betritt Midjourney kühn das wettbewerbsintensive Feld der KI-Videogenerierung – und reiht sich damit in die Riege von OpenAI’s Sora, Runways Gen-3/Gen-4 und Google Veo ein.

Was ist Midjourney Video V1?

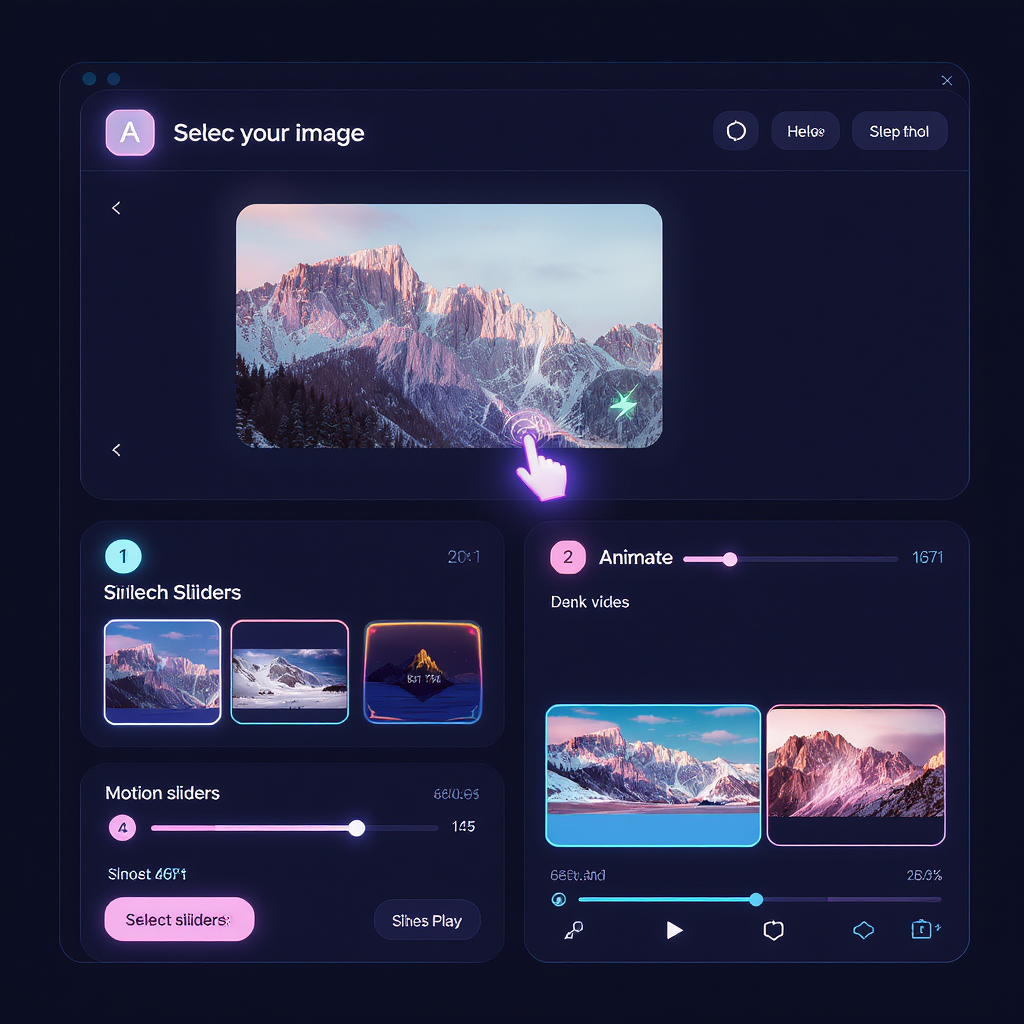

Midjourney Video V1 ist das erste offizielle Videogenerierungsmodell des Unternehmens, das entwickelt wurde, um ein einzelnes Bild in Animationen mit fließenden Bewegungen und stilistischer Konsistenz umzuwandeln. Aktuell funktioniert das System, indem ein Standbild (innerhalb von Midjourney oder extern erstellt) hochgeladen und in bis zu vier animierte Videoclips umgewandelt wird, die jeweils etwa 5 Sekunden lang sind.

Diese Clips können aneinandergereiht oder schrittweise erweitert werden, um längere Szenen zu erstellen, mit einer maximalen Gesamtlänge von ca. 21 Sekunden.

Hauptmerkmale von V1

🎬 Bild-zu-Video-Animation

- Verwandeln Sie jedes statische Bild in eine bewegte Szene.

- Vier unterschiedliche Bewegungspfade werden zur Variation generiert.

- Funktioniert am besten mit Bildern, die von Midjourney V7 generiert wurden, unterstützt aber auch andere Quellen.

⚙️ Bewegungssteuerung

- Geringe Bewegung: Subtile Animation – ideal für Porträts, Landschaftsaufnahmen oder sanfte Umgebungsbewegungen.

- Hohe Bewegung: Mehr Dynamik – filmischer mit Objekt- und Hintergrundbewegungen.

- Gepromptete Bewegung: Geben Sie einen neuen Prompt ein, um die Animationsrichtung oder -absicht zu beeinflussen.

🔁 Erweiterbare Sequenzen

- Clips in 4-Sekunden-Schritten verlängern.

- Maximale Clip-Dauer: 21 Sekunden.

💡 Anwendungsfälle

- Animierte Konzeptkunst

- Stilisierte Storyboards

- Zeichentestanimationen

- Fantasy- oder surreale Bewegungsschleifen für kreative Projekte

So verwenden Sie Midjourney Video V1

- Generieren oder laden Sie ein Bild mit Midjourney V7 hoch.

- Wählen Sie das Bild aus und klicken Sie über Discord oder die Web-Benutzeroberfläche auf „Animieren“.

- Wählen Sie die Bewegungseinstellungen:

- Automatisch oder Manueller Prompt

- Geringe oder hohe Bewegung

- Warten Sie einige Sekunden, während die KI vier Bewegungsvarianten rendert.

- Laden Sie den Clip herunter und verlängern Sie ihn bei Bedarf.

Preise und Zugang

- In allen kostenpflichtigen Tarifen enthalten (Basic und höher; ab $10/Monat).

- Jede Videogenerierung verbraucht etwa 8x so viele GPU-Minuten wie ein Standbild.

- Relax Mode (verfügbar in Pro- & Mega-Tarifen) ermöglicht eine Generation mit geringerer Priorität, aber geringeren Kosten.

- Web-Oberfläche und Discord werden beide unterstützt.

Vorteile gegenüber Mitbewerbern

| Funktion | Midjourney V1 | Runway Gen-4 | OpenAI Sora (privat) | Google Veo 3 |

|---|---|---|---|---|

| Fokus | Bild → Video | Text → Video | Text → Kinovideo | Text/Bild → Video |

| Max. Länge | ~21s | 4–8s | Bis zu 60s | ~60s |

| Stilkonsistenz | Hoch | Moderat | Sehr hoch | Hoch |

| Öffentlicher Zugang | ✅ (via Discord & Web) | ✅ | ❌ | ❌ |

| Bewegungssteuerung | Prompt + Schieberegler | Begrenzt | Erweitert (zukünftig) | Begrenzt |

Einschränkungen und bekannte Probleme

Trotz seiner beeindruckenden Optik steckt V1 noch in den Anfängen:

- Bewegungsartefakte: Gliedmaßen oder Hintergründe können sich unnatürlich verändern oder zittern.

- Wiederholende Schleifen: Video wirkt manchmal zyklisch oder es fehlt an narrativer Kohärenz.

- Komplexe Prompts: Aktuell ist das Motion-Prompt-System nicht so granular wie textbasierte Videomodelle.

- Keine Tonunterstützung: Alle Videos sind vorerst stumm.

Midjourney hat dies als Wachstumsschmerzen anerkannt und plant kontinuierliche Updates.

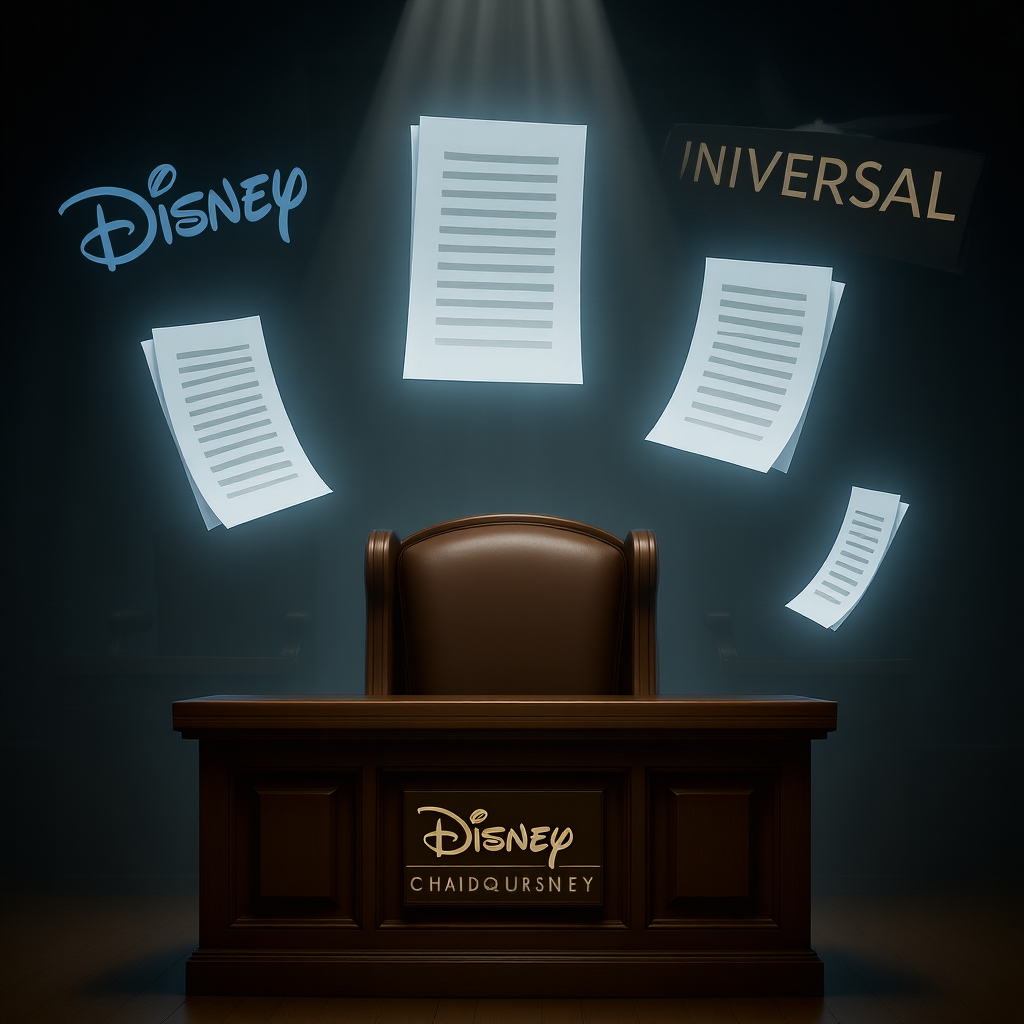

Rechtliche Überlegungen

Midjourneys Expansion in den Videobereich erfolgt inmitten wachsender rechtlicher Bedenken. Am 11. Juni 2025 reichten Medienriesen wie Disney und Universal eine Klage ein, die behauptet, dass ihre urheberrechtlich geschützten Werke möglicherweise zum Trainieren von Midjourneys Modellen verwendet wurden. Obwohl die Animationswerkzeuge von V1 nicht direkt Inhalte generieren, die IP-Verletzungen darstellen, sollten Urheber vorsichtig sein, insbesondere wenn sie bekannte visuelle Designs wiederverwenden.

Die Zukunft von Midjourney Video

Laut den Entwicklern von Midjourney ist V1 nur der erste Schritt. Zukünftige Pläne umfassen:

- Echtzeit-Generierung

- 3D-Animation und räumliche Modellierung

- Anpassung des Kamerawegs

- Audio- und Dialogintegration

Dies bringt Midjourney auf den Weg, sich zu einer vollständigen Kreativsuite zu entwickeln – nicht nur ein Werkzeug für visuelle Kunst, sondern eine potenzielle Pipeline für ganze animierte Szenen, Konzepttrailer und Echtzeit-Inhaltsgenerierung.

Letzte Gedanken

Midjourney Video V1 ist ein aufregender Sprung für Kreative, Animatoren, Geschichtenerzähler und bildende Künstler. Obwohl es noch nicht die erzählerische Tiefe von OpenAIs Sora oder den filmischen Glanz von Google Veo erreicht, machen seine Zugänglichkeit, ästhetische Klarheit und schnelle Bereitstellung es zu einem der aufregendsten Tools in der aktuellen generativen KI-Landschaft.

Wenn Sie bereits Midjourneys Bildästhetik lieben und Ihre Kunst zum Leben erwecken möchten – Video V1 ist Ihr nächstes unverzichtbares Tool.

FAQs

F1: Was ist Midjourney Video V1?

A1: Midjourney Video V1 ist ein KI-Modell, das ein einzelnes Bild in animierte Videoschleifen umwandelt. Es generiert vier Bewegungsvariationen und unterstützt bis zu 21 Sekunden Animation.

F2: Kann ich jedes beliebige Bild verwenden, oder muss es von Midjourney stammen?

A2: Obwohl jedes Bild verwendet werden kann, werden die besten Ergebnisse mit Bildern erzielt, die von Midjourney V7 generiert wurden, da diese für die Animationskompatibilität optimiert sind.

F3: Wie viel kostet es, ein Video zu generieren?

A3: Die Videogenerierung verbraucht etwa 8x so viele GPU-Minuten wie ein einzelnes Bild und ist in allen kostenpflichtigen Tarifen ab $10/Monat verfügbar. Pro-Benutzer können den günstigeren Relax-Modus nutzen.

F4: Welche Bewegungssteuerungen sind verfügbar?

A4: Sie können zwischen den Modi „Geringe Bewegung“ und „Hohe Bewegung“ wählen oder einen Prompt eingeben, um die Bewegungsrichtung zu steuern. Jede Einstellung beeinflusst die Intensität und das Verhalten der Animation.

F5: Wird Ton in den generierten Videos unterstützt?

A5: Nein, Midjourney Video V1 generiert derzeit stumme Videos. Audiofunktionen sind noch nicht enthalten, könnten aber in zukünftigen Updates berücksichtigt werden.

Empfohlene Lektüre

Erfahren Sie mehr über generative KI und visuelle Kreativität in diesen Artikeln:

-

Bringen Sie Ihre Fantasie zum Leben — Erstellen Sie Anime im Studio-Ghibli-Stil mit FluxPros AI Anime Art Generator

Entdecken Sie, wie Sie Ihre Ideen mit dem intuitiven Generierungsmodell von Flux AI in traumhafte Anime-Visuals im Studio Ghibli-Stil verwandeln können. -

Einführung in FLUX-1 Kontext: Ein umfassender Leitfaden zum KI-Bildgenerierungs- und Bearbeitungstool der nächsten Generation

Ein tiefer Einblick in die Echtzeit-KI-Funktionen von FLUX Kontext für visuelle Generierung, Verfeinerung und multimodale Bearbeitung. -

Erstellen Sie romantische Momente mit Flux AIs AI Kissing Video Generator

Erfahren Sie, wie KI einfache Prompts in zärtliche, romantische Momente mit Video verwandeln kann, perfekt für Geschenke oder Storytelling.

Flux AI Alternativen für Videokreativität

Wenn Sie nach Alternativen zu Midjourneys Video- und Bildtools suchen, probieren Sie diese leistungsstarken Flux AI Modelle aus:

-

Flux Kontext

Ein robustes visuelles Generierungstool mit Prompt-Verkettung, Referenz-Uploads und Stilkontrolle – ideal für Standbilder und hybride Workflows. -

Ideogram AI Generator

Bringen Sie Text in visuelle Elemente mit typografischer Animation, perfekt für Untertitel, Banner oder narrative Szenen. -

Ghibli Art Video Generator

Verwandeln Sie Ihre Konzeptkunst in animierte Schleifen im Ghibli-Stil – skurril, emotional und KI-gestützt für kurze Storytelling-Videos.